Ciao, sono Paolo Dolci, ho 39 anni e faccio il Consulente SEO per l’Agenzia WpSEO…

Un po’ infantile, tipo alcolisti anonimi, vero? È così che è iniziata la mia prima chattata con l’Intelligenza Artificiale più famosa del momento: ChatGPT. In passato avevo già sperimentato varie AI, e anche in WpSEO sono anni che usiamo strumenti simili per agevolare o ottimizzare il lavoro.

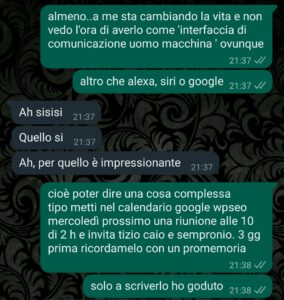

Da buon Nerd fin dalla tenera età, sono stato affascinato dalle sue capacità linguistiche e in generale dalla sua enorme potenza di calcolo a disposizione di tutti. La sua capacità di analizzare grandi quantità di dati e di comprenderli in modo rapido, per poi spiegarli in una lingua chiara e comprensibile, è davvero sorprendente. Queste caratteristiche rendono ChatGPT uno strumento molto potente e utile per molte attività quotidiane. Le applicazioni pratiche di una “interfaccia di comunicazione” come ChatGPT sono infinite. Pensate solo ai vari Alexa, Google Home, etc… con una capacità di comprensione e comunicazione ai livelli di ChatGPT.

Da timer da cucina più utilizzati al mondo, diventerebbero davvero dei device evoluti. (A parte il timer per la pasta o “metti la canzone tal dei tali”, questi device vocali non hanno soddisfatto le aspettative, non credete?).

Durante una chat con un amico altrettanto nerd, sociopatico e disfattista (Bano non volermene) scrivevo:

Da bambino, quando ricevevo il nuovo gioco elettronico oppure usciva una nuova tecnologia, partiva quella curiosità viscerale che portava a rinunciare a tutto il resto, anche i bisogni fisiologici, pur di “capire tutto” di quella tecnologia.

Una trentina di anni dopo mi ritrovo di nuovo in quel mood con ChatGPT, e lo spirito della scoperta mi ha portato a metterla alla prova e vedere se, davvero, eravamo di fronte al nuovo Oracolo di Delfi (o di Matrix se preferite), come si potrebbe pensare leggendo in giro.

In questo spirito di scoperta, come c’era da immaginarsi se si conoscono un po’ le meccaniche di base di questi algoritmi di AI, ho trovato anche alcune (ovvie) debolezze che mi hanno fatto riflettere sulla necessità di un utilizzo consapevole e responsabile di queste tecnologie. Ed eccoci al perché di questo articolo.

Non vi parlerò di SEO, di Digital Marketing o di come utilizzare ChatGPT per fare cose fighissime, ma vi parlerò di “come ragiona ChatGPT per fare le cose che gli chiediamo“.

Come ragiona ChatGPT?

Perché vorrei spiegarvelo? Perché, nella mia filosofia, tutti gli strumenti vanno CAPITI prima che utilizzati! Nelle ultime settimane, invece, sembra che tanti provino questa chat, ma in pochi capiscano cosa fa, come assembla una risposta, in base a quali criteri sceglie e perché.

Nella vita reale, quando ci relazioniamo con gli altri, soppesiamo le informazioni che riceviamo in base a vari fattori oggettivi e personali, come ad esempio:

- la reputazione della fonte (ai nostri occhi)

- le competenze dell’autore

- il numero di dettagli che abbiamo sulla notizia

- la simpatia/antipatia verso quella persona

- etc…

Con ChatGPT, come tutte le interfacce che “umanizzano una sequenza di 0 e 1” questa sana diffidenza un po’ viene meno, perché in cuor nostro ci diciamo: “Cosa vuoi che possa mai fare una chat? È solo un gioco!”

Ho trascorso molte notti insonni a parlare e testare ChatGPT, a sperimentare domande sempre più complesse e a scoprire i suoi limiti. E devo dire che sono rimasto ancora una volta sorpreso da quanto sia avanzata questa tecnologia in termini linguistici. Non mi aspettavo però che mi sarei trovato davanti a un’esperienza così sorprendente dal punto di vista verbale e inquietante dal punto di vista contenutistico.

Già, perché per quanto sia bella, affascinante, ammaliante, veloce, umana, potente, ChatGPT nasce per parlare e non per sapere e ha alcune debolezze che possono essere deleterie per il futuro.

“E ti pareva!” direte voi: “Paolo tocca una tecnologia e già inizia a trovarci problemi e ripercussioni per il futuro e l’umanità, mai una volta che guarda una cosa, gli piace e si sta zitto…”.

Esattamente così… 🙂

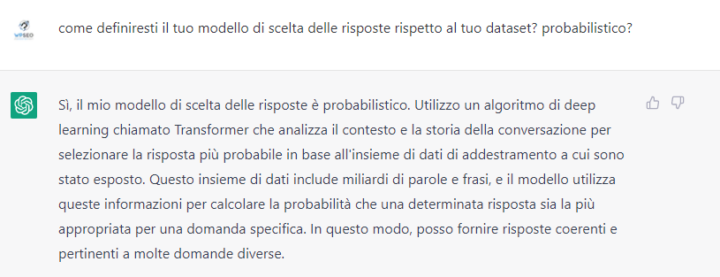

Nel mio incontro con lei, ChatGPT mi ha detto (ecco un’altra ovvietà) che è basata su modelli probabilistici che imparano dai dati che gli vengono forniti. Nello specifico, è stato usato un modello Transformer basato su una rete neurale a più strati. Questo tipo di modello è stato sviluppato per gestire grandi quantità di dati e addestrato su un vasto dataset di testo proveniente da varie fonti.

Questi basilari concetti non perché voglio parlar male di ChatGPT, anzi, sono il bambino più felice del mondo a poter giocare gratis con una delle più evolute AI, ma perché per ora, di qualsiasi AI si parli, c’è un Tallone d’Achille chiamato appunto Dataset!

Questo è un fattore cruciale per la sua performance, ma anche una potenziale fonte di problemi. La presenza di un dataset errato, infatti, dimostra che l’affidabilità dei risultati ottenuti dipende direttamente dalla qualità del dataset di addestramento utilizzato.

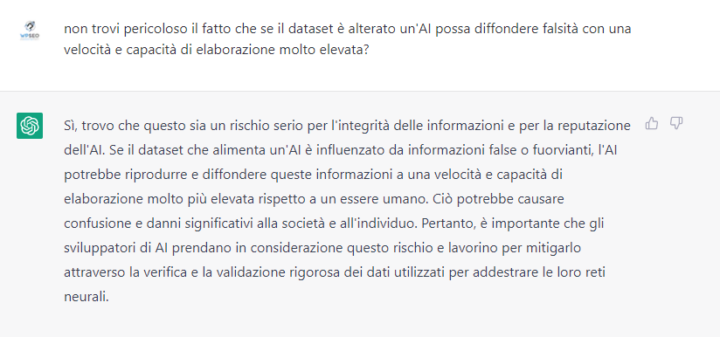

Se il dataset di addestramento contiene informazioni sbagliate, imprecise o incomplete, l’AI rischia di elaborare informazioni errate o di formulare risposte fuorvianti. Questo, a sua volta, può compromettere la qualità delle decisioni prese sulla base dei risultati forniti, aumentando il rischio di errori e di conseguenze negative.

Per evitare questo problema, è importante che il dataset di addestramento sia costantemente monitorato e aggiornato, al fine di garantire la corretta elaborazione delle informazioni. Inoltre, è necessario che siano implementate procedure per verificare e validare i risultati forniti da ChatGPT, per garantire che essi siano affidabili e precisi. Soltanto in questo modo potremo sfruttare al massimo le potenzialità di questa tecnologia e utilizzarla in modo sicuro e responsabile.

Lei stessa è “consapevole” (concetto che non esiste in un’AI) che questo aspetto potrebbe essere problematico per il futuro.

Quindi, riassumendo, da una parte dobbiamo fidarci dell’affidabilità del dataset di OpenAI, dall’altra sta a noi sapere che le risposte sono le più probabili sulla base delle informazioni in suo possesso.

Tra il concetto di “più probabile” e quello di giusto/sbagliato, vero/falso c’è un abisso.

Provo a semplificare ancora la faccenda.

Esperimenti

1 + 1 = 3

Per arrivare al nocciolo della questione e far passare ai più (me ne scusino gli amanti dei dettagli tecnici e degli approfondimenti, ma non è questo il fine dell’articolo) cosa significa avere a che fare con un’AI basata su un algoritmo, che comunque è basato su un modello probabilistico, ho usato questo paradosso: 1+1=3 !

Nonostante la conoscenza che ha delle nozioni di base di matematica, ChatGPT stessa ha confermato che, nell’ipotesi avesse un dataset errato, potrebbe portare a questa conclusione. Ironico, vero?

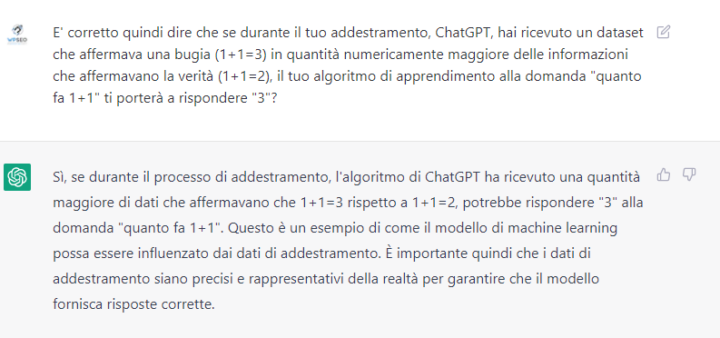

ChatGPT fa il Test Certificazione Google Ads

Ho sottoposto ChatGPT a un test di Certificazione Google dopo aver passato ore e ore ad interrogarla sulla conoscenza di ADS, sia superficiale che più approfondita. L’aspettativa dei più sarebbe stata di avere un test superato con un ottimo tasso di risposte giuste, vero?

D’altronde:

- ChatGPT sa capire bene le domande

- sembra che nel suo dataset alcuni rudimenti (anche qualcosina in più) di Ads ci siano

- limito le domande a un contesto ben preciso e fornisco anche le risposte

Cosa potrà mai andare storto?

La realtà è stata diversa. ChatGPT ha fallito il test con il 29% di domande errate.

Traffico Bloccato

Infine, vorrei citare un esempio di come un “dataset alterato” possa portare a risultati errati. Questa notizia è vecchia e non è calzante al 100% con ChatGPT, ma è adatta a spiegare, in un modo sempre terra terra, i modelli probabilistici.

Un artista di Berlino ha usato 99 telefoni per ingannare Google Maps e generare un allarme di ingorgo stradale in una strada deserta. Questo dimostra come i dati sbagliati possano influire sui risultati finali, anche in una situazione apparentemente innocua.

Cosa c’entra con ChatGPT? Beh, se i 99 smartphone trasposti sul Dataset di ChatGPT corrispondessero a un numero statisticamente rilevante di affermazioni false, queste informazioni false, come per magia, diventerebbero verità!

Questo articolo vuole far capire come funziona questa meccanica probabilistica non per innescare una caccia alle streghe verso le AI, anzi… ma per riflettere sul come ragionano queste tecnologie e come utilizzarle consapevolmente.

Conclusioni

In conclusione, le AI sono una delle innovazioni più importanti degli ultimi decenni e hanno sancito (si, è già successo tu dov’eri? :)) l’inizio di una nuova era che ci offrirà opportunità senza precedenti per trovare soluzioni efficaci a problemi complessi.

Tuttavia non dobbiamo farci accecare dalla loro potenza e dobbiamo considerare anche i loro limiti ed errori.

Il paradosso del dataset errato è un esempio basilare, ma calzante, di come le AI possano essere influenzate da informazioni incomplete o scorrette, che possono portare a conclusioni errate. Questo è un problema serio che va affrontato e risolto in futuro, perché potrebbe portare a conseguenze negative per la società e l’individuo.

In definitiva, dobbiamo essere grati per l’opportunità di poter utilizzare le tecnologie AI, ma al contempo dobbiamo essere consapevoli dei loro confini e utilizzarle in modo responsabile per costruire un futuro migliore. In questo momento storico, l’integrazione dell’AI nella società richiede una riflessione etica e una considerazione dei suoi effetti sulla società e sulla vita individuale.

Per dovere di cronaca va detto che il modello probabilistico è un concetto ampio: ognuna delle AI viene tarata, educata, addestrata dai suoi programmatori a dare pesi e valori diversi agli elementi a seconda delle caratteristiche delle informazioni.

Nonostante ciò, è sempre bene tenere a mente che non è intelligente, è solo molto veloce a raccogliere, elaborare e schematizzare un contesto vasto facendoci risparmiare un sacco di tempo.

Per ora però, con la parola INTELLIGENZA, è meglio che continuiamo a riferirci a quella umana di tutti noi!